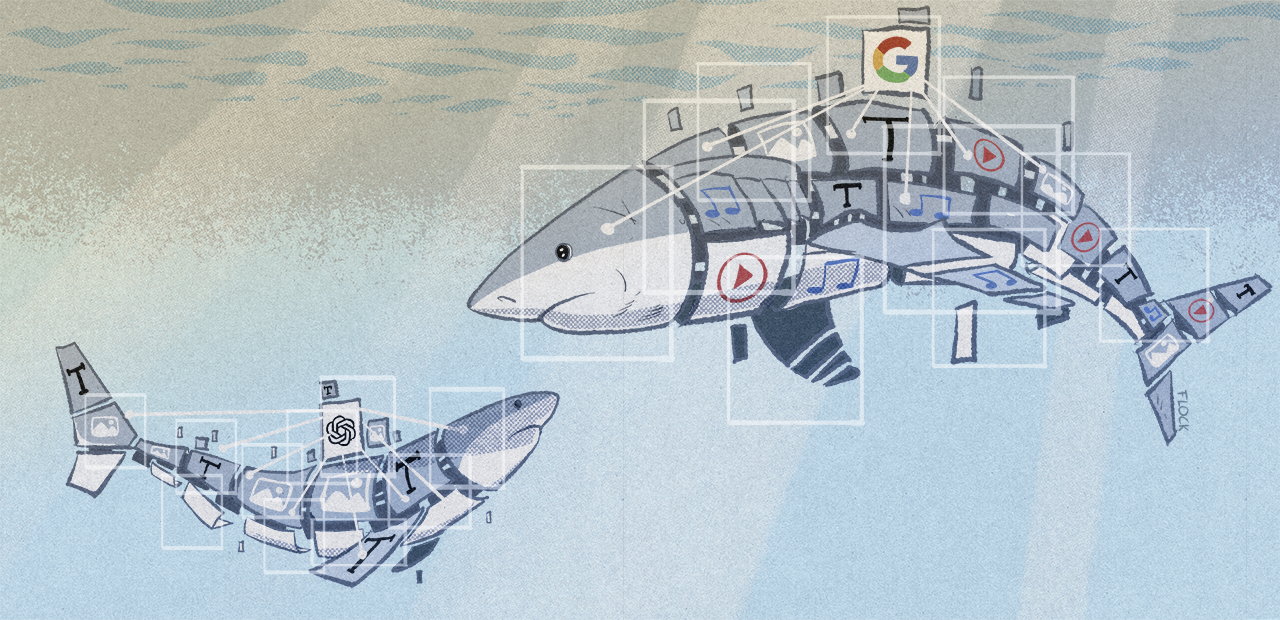

Who will watch the superintelligence?

OpenAI a subi mercredi 15 mai les départs de deux de ses chercheurs qui dirigeaient son équipe nommée « Superalignment » : Ilya Sutskever et Jan Leike. Ceux-ci travaillaient au sein d’OpenAI sur des travaux de recherche en vue de maitriser l’avènement d’une potentielle IA générale que toute l’équipe dirigeante de l’entreprise affiche comme imminente.

Sam Altman a publié un billet de blog pour annoncer la nouvelle : « Ilya et OpenAI vont se séparer. C’est très triste pour moi ; Ilya est sans aucun doute l’un des plus grands esprits de notre génération, un phare dans ce domaine et un ami cher. Son génie et sa vision sont bien connus. Sa chaleur et sa compassion sont moins connues, mais non moins importantes ».

Ilya Sutskever est co-fondateur d’OpenAI et était depuis le début son responsable scientifique.

Jan Leike, un autre membre de l’équipe de recherche d’OpenAI, a annoncé en parallèle son départ d’un bref « j’ai démissionné » sur Twitter. Tous les deux étaient à la tête de l’équipe « Superalignment » d’OpenAI.

La persuasion d’un avènement proche de l’intelligence artificielle générale

Persuadés que l’intelligence artificielle générale (AGI) est proche, ils ont monté cette équipe au sein de l’entreprise il y a un peu moins d’un an dans le but de trouver des solutions « pour piloter et contrôler des systèmes d’IA beaucoup plus intelligents que nous ».

Sans aucune pincette ni fondement scientifique, cette équipe affirmait que « la superintelligence sera la technologie la plus importante que l’humanité ait jamais inventée et pourrait nous aider à résoudre bon nombre des problèmes les plus importants du monde ».

« Mais l’immense pouvoir de la superintelligence pourrait aussi être très dangereux et conduire à la déresponsabilisation de l’humanité, voire à son extinction », expliquaient-ils, ce qui justifiait la création d’une telle équipe au sein de l’entreprise leader de l’IA générative.

Dans son tweet annonçant son départ, Ilya Sutskever ré-affirme être « convaincu qu’OpenAI construira une AGI à la fois sûre et bénéfique ».

Pourtant, Ilya Sutskever fait partie des membres du Conseil d’administration qui avaient voté pour le départ de Sam Altman au début de la semaine de folie de novembre dernier pendant laquelle le CEO d’OpenAI a été limogé puis réintégré, après un passage éclair chez Microsoft.

Il avait ensuite regretté sa participation « aux actions du conseil d’administration ». Comme l’expliquait à l’époque The Atlantic, les tensions au sein d’OpenAI étaient dues, en partie, à cause d’une divergence profonde : « alors qu’Altman et Greg Brockman [qui a suivi Sam Saltman dans ses allers-retours, ndlr], président d’OpenAI, encourageaient une commercialisation accrue, le responsable scientifique de l’entreprise, Ilya Sutskever, s’inquiétait de plus en plus de savoir si OpenAI respectait la mission de l’association à but non lucratif qui consistait à créer des IAG bénéfiques ».

À la réintégration de Sam Altman, Ilya Sutskever a quitté le conseil d’administration tout en restant à son poste de responsable scientifique.

Dans son billet, Sam Altman annonce qu’Ilya Sutskever sera remplacé par Jakub Pachocki, qui était jusque-là responsable de l’équipe de recherche de l’entreprise sur l’optimisation du deep learning et de l’apprentissage par renforcement à grande échelle.

De son côté, Jan Leike devrait être remplacé par John Schulman qui était responsable de l’équipe qui travaille sur l’apprentissage par renforcement.

Depuis le début de l’année, Daniel Kokotajlo,William Saunders, Leopold Aschenbrenner et Pavel Izmailov, d’autres membres (ou ex-membres) de l’équipe « Superalignment » ont, eux aussi, quitté le navire. Dans le cas des deux derniers, il s’agit d’un licenciement suite à des fuites d’informations.

Si John Schulman doit prendre la tête de cette équipe de plus en plus vide, il n’est pas sûr que Jakub Pachocki reprenne aussi cette responsabilité.

Peu de résultats de recherche

À la création de l’équipe « Superalignment » en juillet 2023, celle-ci se donnait quatre ans pour résoudre le « problème » du manque de moyen pour « pour piloter et contrôler des systèmes d’IA beaucoup plus intelligents que nous ».

L’équipe a, en un an et depuis sa création, mis en ligne un seul article dans laquelle elle se pose la question « Peut-on utiliser un modèle plus petit (moins performant) pour superviser un modèle plus grand (plus performant) ? ». Elle y expliquait que « lorsque nous supervisons GPT-4 avec un modèle de niveau GPT-2 en utilisant cette méthode pour des tâches de Traitement automatique du langage naturel, le modèle résultant a généralement des performances comprises entre GPT-3 et GPT-3.5 ». Les chercheurs de l’équipe concluaient néanmoins qu’ « il existe encore d’importantes disparités entre notre configuration empirique actuelle et le problème ultime de l’alignement des modèles surhumains ».

Il reste trois ans à leurs remplaçants pour atteindre le but que s’était fixé l’équipe, si la volonté est encore là de pousser la recherche de l’entreprise dans ce sens.

Car ces départs montrent que ceux qui affichaient les positions les plus effrayées face à l’arrivée prochaine d’une intelligence artificielle générale n’ont plus un poids significatif au sein d’OpenAI.